Tworzenie awatarów. Kto w ogóle ma na to czas? Komputery – oto, kto. Jeśli Facebook rozwinie swoją eksperymentalną technologię, to już wkrótce nie będziemy musieli się siłować z internetowymi kreatorami awatarów, a zawierzymy uczeniu maszynowemu. Jak wyglądają efekty pracy facebookowych algorytmów?

Nie jest to pierwsza tego typu inicjatywa, bo Google prezentowało efekty podobnych badań w maju tego roku. Kreskówkowe twarze były jednak tylko pewnym wyobrażeniem, łączącym cechy charakterystyczne danej osoby, takie jak rude, kręcone włosy, okulary, piegi czy duży nos. Następnie algorytmy Google przeszukiwały sieć w poszukiwaniu wizualizacji tych cech i łączyły je w zabawną buźkę.

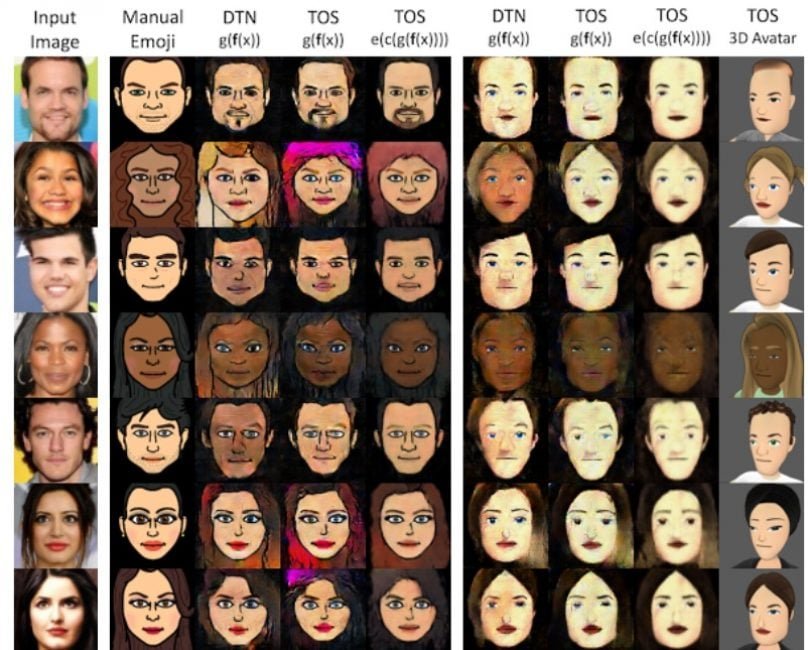

Podejście Facebooka jest inne – tu chodzi o jak najlepszą reprodukcję czyjejś twarzy, w różnej wersji. Algorytmy starają się ukazać oblicze użytkownika wiernie, bez względu na narzędzie, w jakim chcielibyśmy je stworzyć. Mogą zatem zaprezentować naszą twarz jako Bitmoji, ale równie dobrze stworzyć naszą podobiznę dla aplikacji wirtualnej rzeczywistości.

System osiąga to, porównując zdjęcie twarzy z jej wyobrażeniem i traktuje zarówno jedno, jak i drugie tak samo. Podchodzi do nich równoważnie, tak jakby awatar był drugim zdjęciem tej samej osoby. Dokonując drobnych modyfikacji grafiki, dochodzi do poziomu w którym algorytm zbliża się do wzoru na tyle, że uznaje awatara za inną wersję tej samej twarzy.

Możliwości takiego narzędzia są naprawdę spore. Rejestrując się na przykład w dowolnej grze VR moglibyśmy nadać postaci naszą twarz, dzięki czemu nasze wirtualne „ja” zyskałoby znajome oblicze, a my zaliczylibyśmy kolejny poziom immersji w grę.

Na międzynarodowej konferencji Computer Vision omówiono to narzędzie dokładniej. Gdybyśmy chcieli wgryźć się w detale, można zapoznać się z dokumentem PDF, w którym szczegółowo opisano, na czym polega działanie algorytmów Facebooka.