Doroczna konferencja Google I/O to idealny czas, aby podsumować to, co już udało się osiągnąć. A Sundar Pichai, czyli CEO Google, zdecydowanie ma powody do radości, ponieważ wszystkie, kluczowe usługi firmy cieszą się stale rosnącą popularnością.

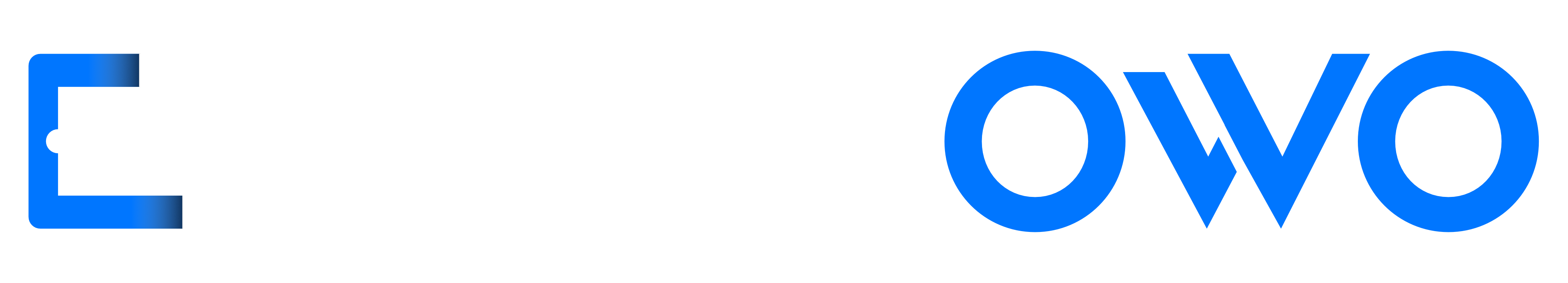

Miesięcznie z usług koncernu z Mountain View (Google, Androida, Chrome, YouTube, Map, Sklepu Play i Gmaila) korzysta ponad miliard użytkowników. I mowa tu o każdej z osobna, nie wszystkich razem wziętych. Do tego codziennie na YouTube użytkownicy oglądają ponad miliard godzin wideo, a w Mapach nawigują przez ponad miliard kilometrów.

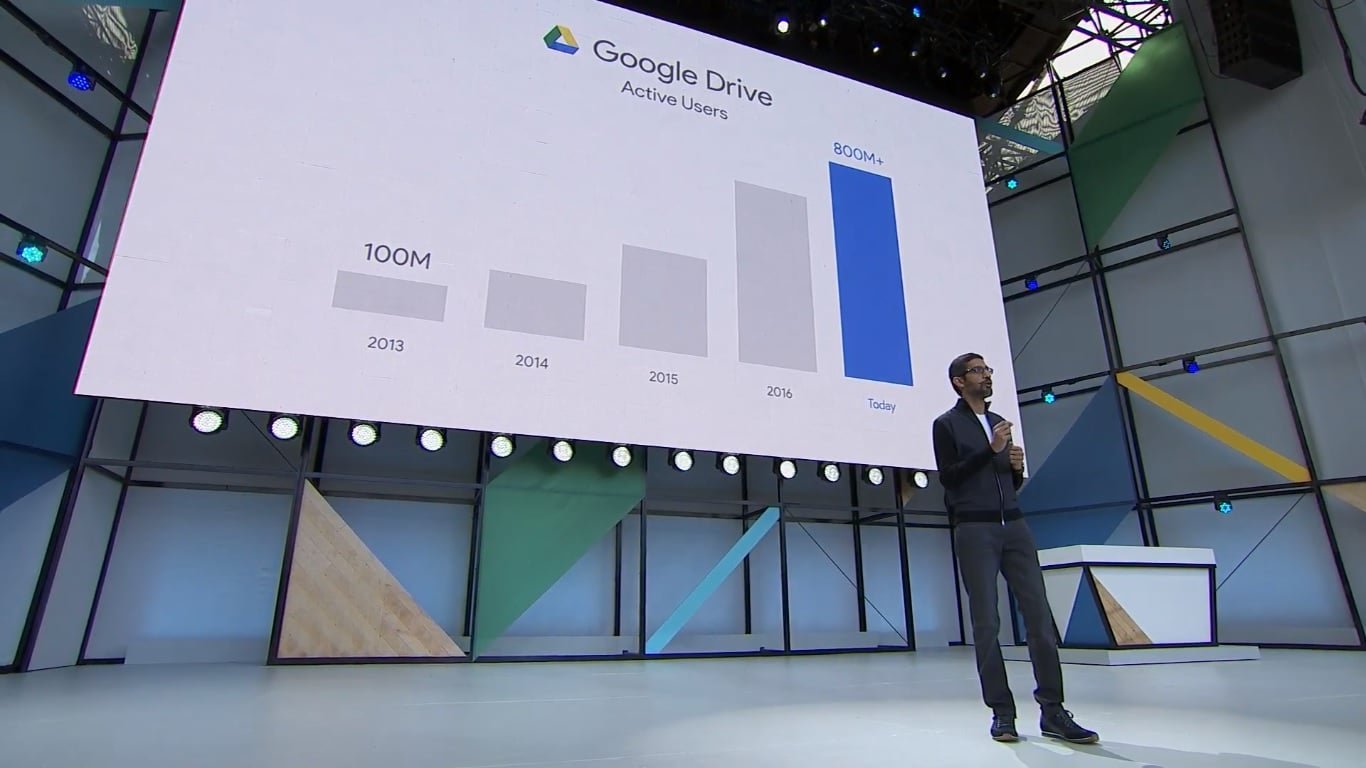

Po pięciu latach od uruchomienia, z Dysku Google korzysta miesięcznie już ponad 800 milionów użytkowników. Dla porównania, w 2013 roku było ich „tylko” 100 milionów. Każdego tygodnia wgrywanych jest do chmury też ponad trzy miliardy plików.

Z kolei dwa lata temu, również na konferencji I/O, zaprezentowano Zdjęcia Google. Dziś korzysta z nich już ponad 500 milionów użytkowników. Każdego dnia do aplikacji wgrywanych jest zawrotna liczba 1,2 miliarda fotografii.

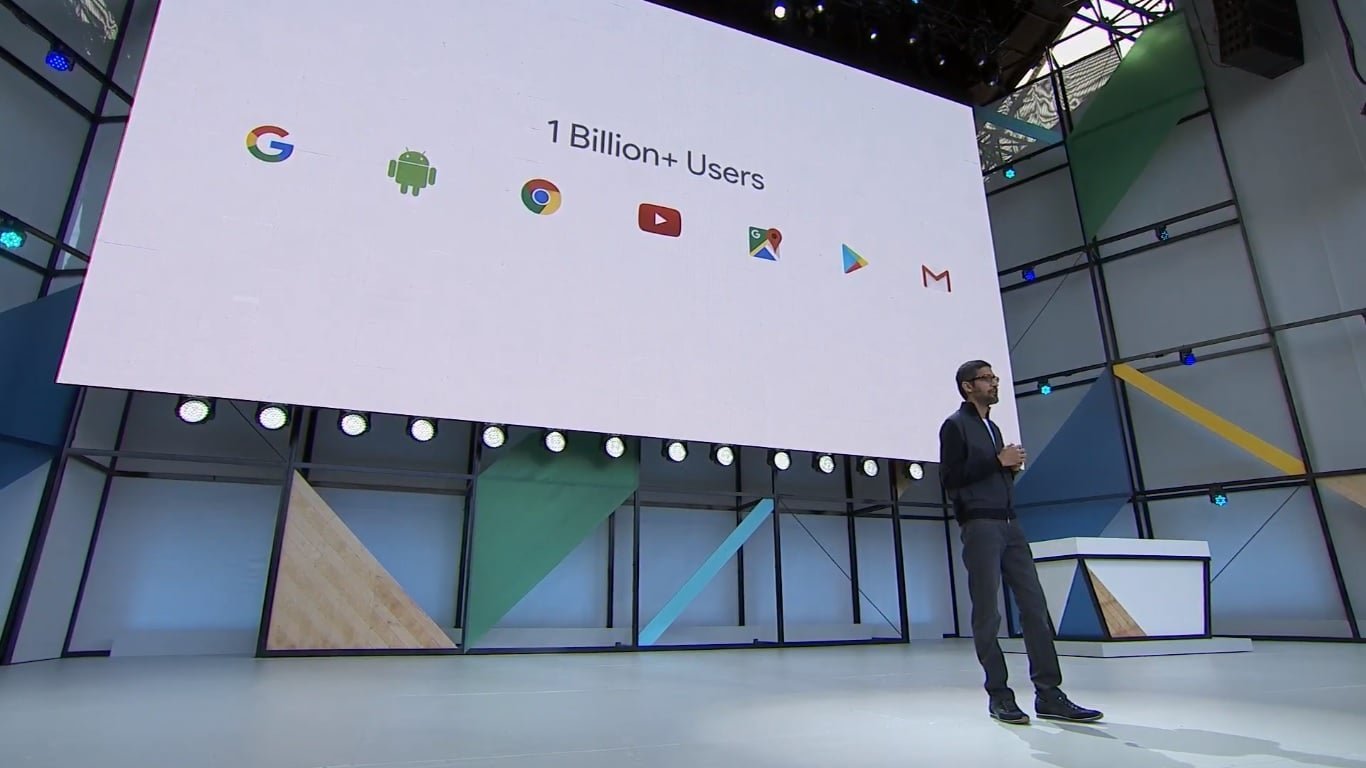

Sundar Pichai z dumą pochwalił się także, że w tym tygodniu odnotowano dwa miliardy aktywnych urządzeń z systemem operacyjnym Android. Znacząca w tym zasługa oczywiście ogromnej popularności smartfonów i tabletów (choć oczywiście nie tylko) z zielonym robocikiem wśród użytkowników.

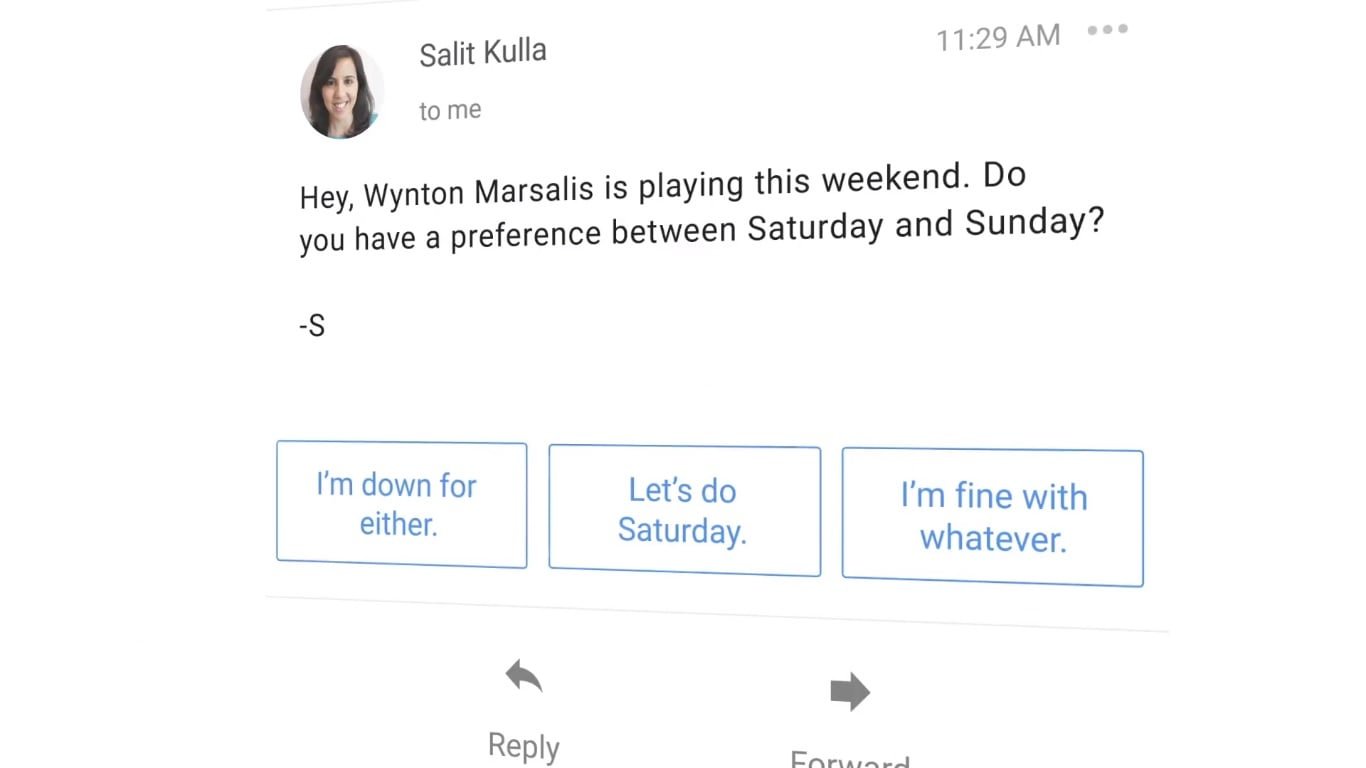

Ostatnimi czasy Google bardzo dużo wysiłku wkłada również w prace nad sztuczną inteligencją oraz uczenie maszynowe. Kolejnym tego owocem jest nowość w postaci inteligentnych odpowiedzi w aplikacji Gmaila. Działa to na podobnej zasadzie, co w Asystencie – rozpoznawany jest kontekst wiadomości i na tej podstawie proponowane są odpowiedzi. Przykład, jak to działa, widzicie poniżej.

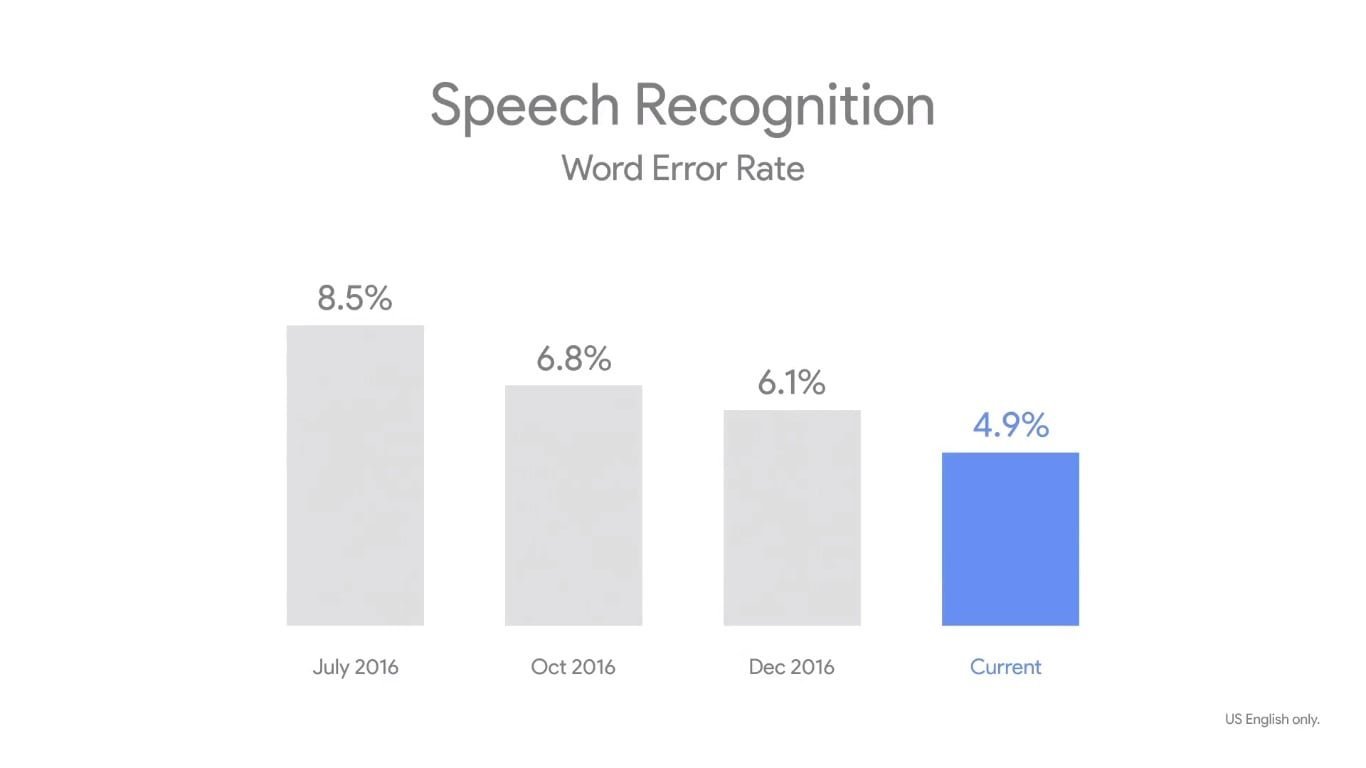

Ważnym elementem w przypadku Google są także mechanizmy rozpoznawania mowy (niezbędne m.in. w Asystencie i Google Home). Koncern stara się stale je udoskonalać i mu się to udaje. Aktualnie współczynnik błędów wynosi już tylko 4,9%, podczas gdy jeszcze w grudniu 2016 roku było to 6,1% (chociaż te dane dotyczą wyłącznie Stanów Zjednoczonych).

Jako ciekawostkę Sundar Pichai podał też, że początkowo w Google Home planowano umieścić aż osiem mikrofonów, aby dobrze lokalizowały źródło dźwięku. Jednak dzięki deep learning i odpowiedniej technice, taki sam efekt i dokładność udaje się uzyskać za pomocą jedynie dwóch mikrofonów. Do tego urządzenie potrafi rozpoznać do sześciu różnych osób i wykonywać spersonalizowane polecenia każdej z nich (więcej na ten temat przeczytacie tutaj).

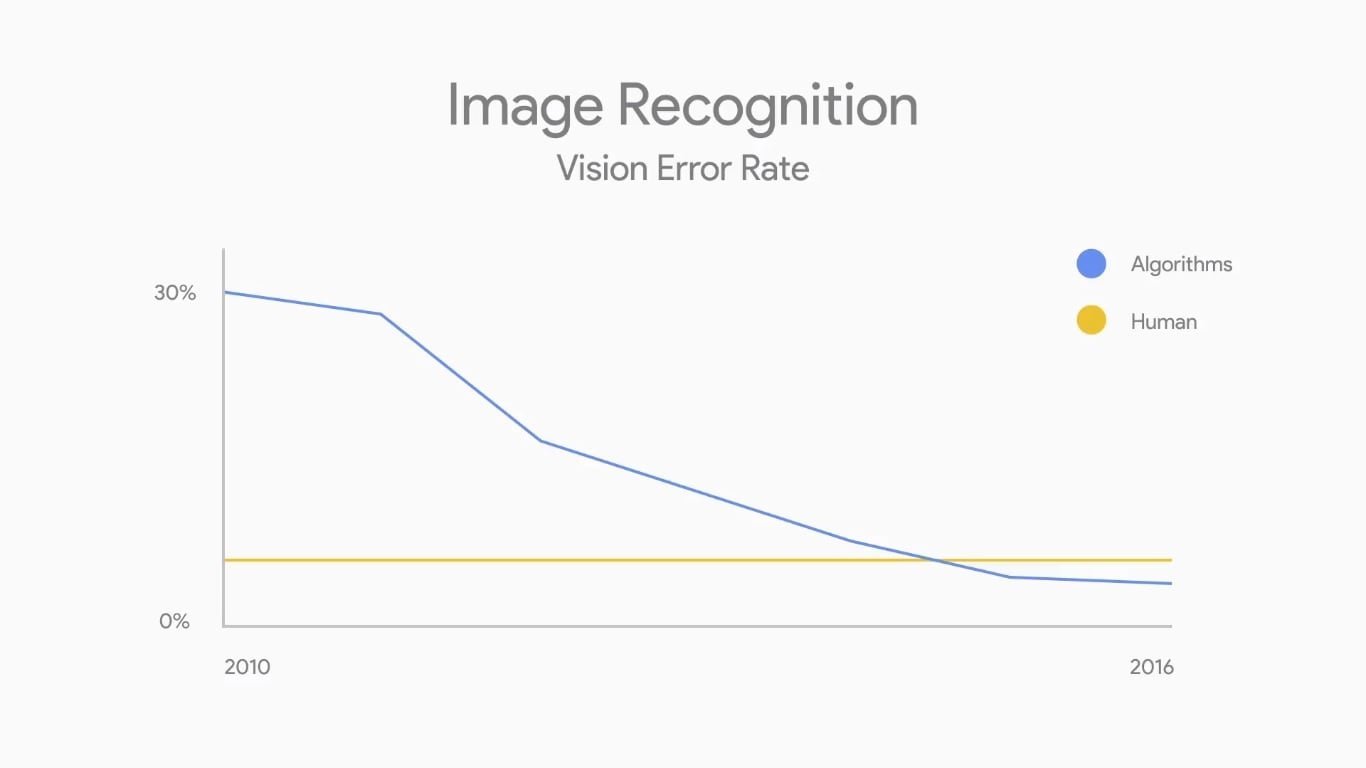

Jednak Google przykłada ogromną uwagę nie tylko do rozpoznawania mowy, ale również treści wizualnych. Odpowiednie algorytmy potrafią przeanalizować zdjęcie i odgadnąć, że jest na nim – na przykład – chłopiec na imprezie urodzinowej, a do tego przypisać mu różne „tagi” (w tym przypadku zabawa, szczęście, tort, niespodzianka, śmiech, ogień, uroczystość, świeczka itd.). Co ciekawe, według Sundara Pichaia robią to już lepiej niż ludzie!

Google Lens

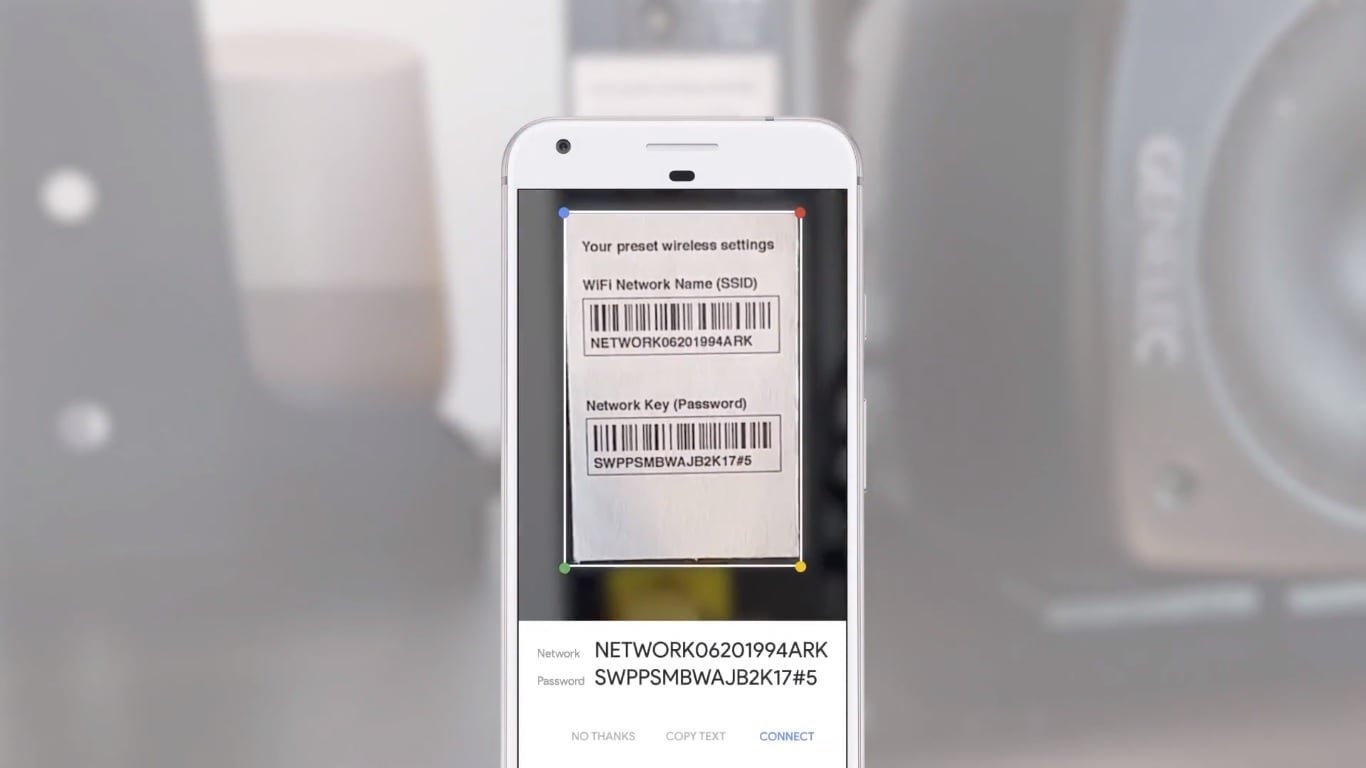

To kolejne rozwiązanie Google, które potrafi – jak to określił Sundar Pichai – zrozumieć to, na co patrzysz i pomóc podjąć akcję w zależności od tego, na co kierujesz swój wzrok (a konkretniej obiektyw aparatu, ponieważ to właśnie za jego pomocą dzieje się ta cała „magia”).

Zasada działania Google Lens jest bardzo prosta. Wystarczy bowiem skierować aparat na – na przykład – jakiś przedmiot, a odpowiednie algorytmy zeskanują go i powiedzą, co to jest i jak się nazywa (na przykład kwiatek czy zwierzę). Za pomocą tego rozwiązania można także szybko połączyć się z Wi-Fi – wystarczy zeskanować etykietę, znajdującą się na routerze, zawierającą wszystkie, niezbędne dane.

Google Lens można wykorzystać także podczas spaceru po mieście. Jeżeli zainteresuje nas jakieś miejsce, wystarczy skierować na nie obiektyw aparatu, a na ekranie smartfona wyświetlą się odpowiednie informacje. Jeśli będzie to – na przykład – restauracja, to pokaże nam się nazwa, ocena oraz jej typ.

Na początku Google Lens pojawią się w Asystencie Google oraz Zdjęciach Google.

Na koniec warto dodać, że jeżeli zasada działania Google Lens wydaje Wam się dziwnie znajoma, to tak, macie rację. Podobnie funkcjonuje Bixby Samsunga.

Źródło: Google I/O’17: Google Keynote (00:42-00:50)