W niedawno opublikowanym manifeście, Mark Zuckerberg napisał, że Facebook jest na unikalnej pozycji, która może pomagać w zapobieganiu próbom samobójczym. Na całym świecie co 40 sekund podejmowana jest jedna z nich. Wśród osób w wieku 15-29 lat, samobójstwo jest drugą najczęstszą przyczyną śmierci.

Obecnie Facebook pracuje nad dodaniem nowych narzędzi do swoich aplikacji, by wspierać osoby, które miewają myśli samobójcze oraz otworzyć pewne możliwości przed tymi, którzy martwią się o stabilność psychiczną i emocjonalną swoich przyjaciół, i chcieliby im pomóc.

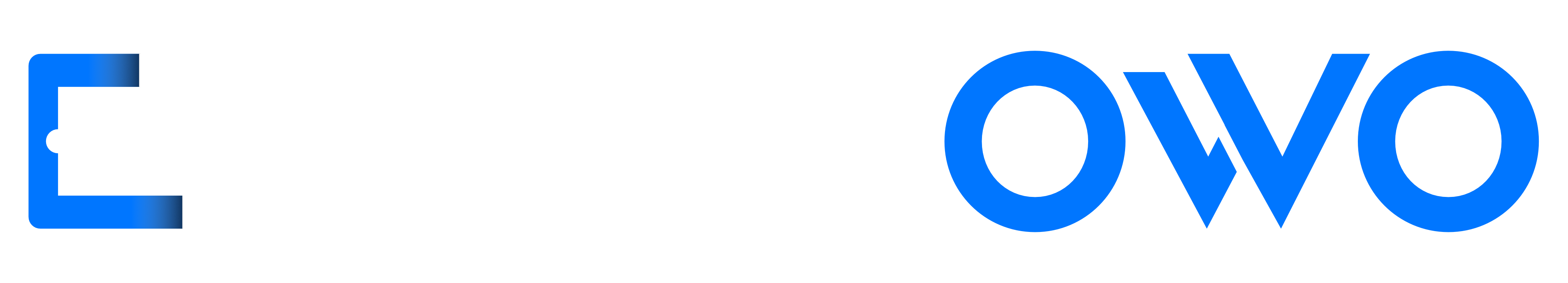

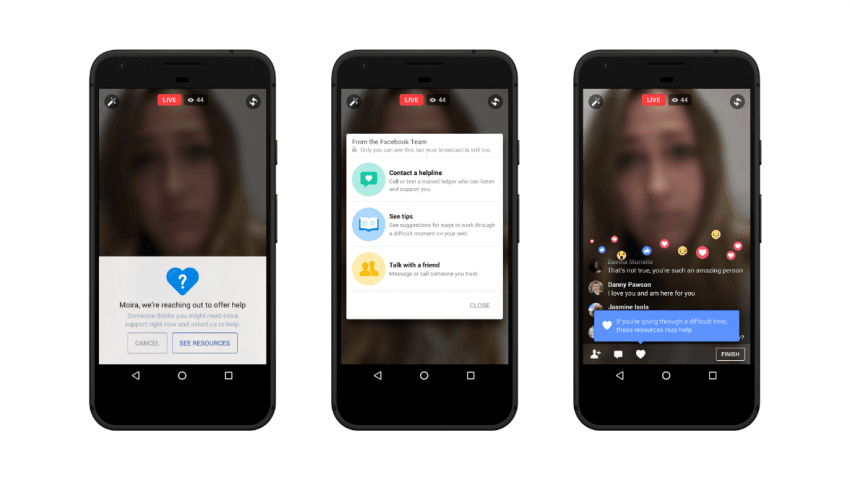

Powiedzmy, że oglądamy transmisję wideo na żywo, nadawaną przez naszego bliskiego znajomego na Facebooku, w trakcie której mówi on coś, co nas zaniepokoi. Teraz będzie można dotrzeć do tej osoby i zgłosić tego typu zachowanie Facebookowi, który zaoferuje kilka dodatkowych możliwości – na przykład bezpośrednią wiadomość do znajomego, propozycję kontaktu ze specjalną linią zaufania czy kilka wskazówek dotyczących pracy w stresującym czasie.

Niektórzy są zdania, że jeśli ktoś wspomina o samobójstwie, to zadaniem Facebooka jest odciąć taką transmisję. Jednak to, czego się nauczyłem podczas pracy z takimi przypadkami to to, że odcięcie strumienia zbyt wcześnie, może uniemożliwić takiej osobie udzielenie pomocy.

– badacz Jennifer Guadagno

Facebook nie staje się organizacją publicznego zdrowia psychicznego ani nie próbuje pomagać ludziom na własną rękę. Współpracuje z organizacjami takimi jak Crisis Text Line, National Eating Disorder Association i National Suicide Prevention Lifeline, które profesjonalnie zajmują się przypadkami zgłoszeń niedoszłych samobójców, osób z zaburzeniami odżywiania czy przeżywających tymczasowy kryzys psychiczny lub emocjonalny.

Wielu ludzi rezygnuje z prośby o pomoc, jeśli tylko zaistnieje ku temu jakakolwiek, nawet mała, przeszkoda. Mamy nadzieję, że dodatkowe drzwi, które otwieramy, wprowadzając takie zmiany, zmniejszą opory takich osób i spowodują, że skorzystają one z fachowej opieki.

– Vanessa Callison-Burch, menedżer produktowy Facebooka

Facebook pracuje również nad wykorzystaniem sztucznej inteligencji, by rozpoznawać wzorce oparte na wcześniej zgłoszonych przypadkach, by zidentyfikować posty osób, które mogłyby mieć skłonności samobójcze. Jeśli schemat wypowiedzi będzie pasował do szablonu, zespół operacyjny Facebooka przejrzy go i w razie potrzeby zaproponuje odpowiednią pomoc.

Czy uważacie taki pomysł za słuszny sposób pomocy?

źródło: TechCrunch